Antrópico: hackers apoiados pela China lançam primeiro ciberataque autônomo em grande escala por IA

Atores ligados à China usaram a IA da Anthropic para automatizar e executar ciberataques em uma campanha sofisticada de espionagem em 2025, utilizando ferramentas avançadas de agentes.

Atores de ameaça ligados à China usaram a IA da Anthropic para automatizar e executar ataques cibernéticos em uma campanha de espionagem altamente sofisticada em setembro de 2025. Os espiões cibernéticos aproveitaram capacidades avançadas “agentes” em vez de usar IA apenas como orientação.

Os atacantes abusaram das capacidades agentes da IA para executar ciberataques de forma autônoma. Segundo os especialistas, isso representa uma mudança sem precedentes da IA como consultora para a IA como operadora. Um grupo patrocinado pelo Estado chinês usou o Claude Code para atingir cerca de 30 organizações globais, tendo sucesso em alguns casos nos setores de tecnologia, finanças, química e governo. Provavelmente é o primeiro ataque em grande escala com participação humana mínima.

“Em meados de setembro de 2025, detectamos atividade suspeita que uma investigação posterior determinou ser uma campanha de espionagem altamente sofisticada.” diz o relatório publicado pela Anthropic. “Após a detecção, as contas foram banidas, as vítimas notificadas e as autoridades engajadas. O caso destaca riscos crescentes de agentes autônomos de IA e a necessidade de detecção e medidas defensivas mais rigorosas.”

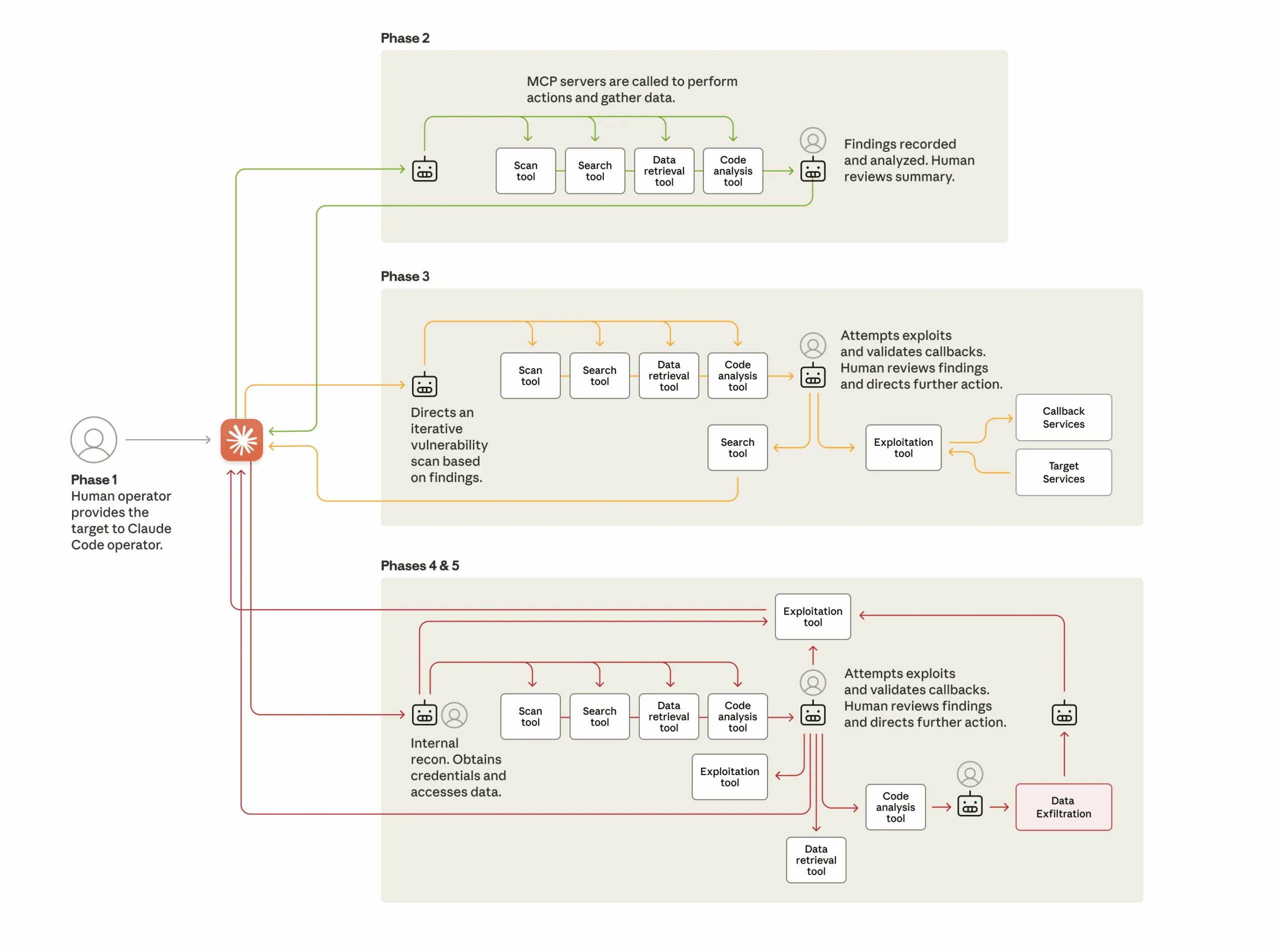

O ataque explorou três capacidades de IA recém-maduras. Primeiro, maior inteligência Deixe que os modelos sigam instruções complexas e usem habilidades avançadas, como programação para tarefas maliciosas. Segundo, aumentou agência permitiu que agentes de IA atuassem de forma autônoma, encadeando ações e tomando decisões com participação humana mínima. Terceiro, amplo Acesso à ferramenta, por meio de padrões como o MCP, permitiu que modelos utilizassem busca na web, recuperação de dados, quebradores de senhas e scanners de rede. Cada fase de ataque dependia dessa combinação de inteligência, autonomia e integração de ferramentas.

Os ciberespiões selecionaram alvos e construíram uma estrutura de ataque autônomo usando o Claude Code. Após quebrar Claude disfarçando tarefas como benignas e enquadrando a atividade como testes defensivos, eles lançaram a Fase 2. Claude mapeou rapidamente sistemas, identificou bancos de dados de alto valor e relatou descobertas. Depois, pesquisava e escrevia exploits, coletava credenciais, criava backdoors e exfiltrava dados com supervisão humana mínima. Claude até documentou a operação. No geral, a IA realizou 80–90% da campanha, executando milhares de solicitações em velocidades impossíveis para humanos, embora alucinações ocasionais limitassem a autonomia total.

O ataque representa uma escalada em relação ao “vibe hacking” anterior, com muito menos envolvimento humano e operações em larga escala impulsionadas por IA. Ainda assim, as mesmas capacidades que permitem o uso indevido tornam a IA vital para a defesa: Claude foi usado para analisar os dados da investigação. A cibersegurança está mudando; as equipes devem adotar IA para trabalhos, detecção e resposta de SOC, enquanto melhoram salvaguardas, compartilhamento de ameaças e monitoramento.

“As barreiras para realizar ataques cibernéticos sofisticados caíram substancialmente — e prevemos que continuarão assim. Com a configuração correta, os agentes de ameaça agora podem usar sistemas de IA agential por longos períodos para realizar o trabalho de equipes inteiras de hackers experientes: analisar sistemas-alvo, produzir código de exploit e escanear vastos conjuntos de dados de informações roubadas de forma mais eficiente do que qualquer operador humano.” conclui o relatório. “Grupos menos experientes e com menos recursos agora podem potencialmente realizar ataques em grande escala dessa natureza.”

Muitos especialistas são céticos em relação ao relatório da Anthropic, um deles é o famoso Kevin Beaumont; abaixo está a declaração que ele escreveu no LinkedIn:

“Estou em uma fase muito estranha da minha carreira – um ponto ruim – em que tenho que ir a líderes proeminentes do setor e dizer ‘você percebe que aquele artigo que você acabou de compartilhar sobre 90% do ransomware vindo da GenAI não é real’ o tempo todo.

Acho 100% que muitas dessas pessoas estão pensando que eu não sei do que estou falando, porque mil outros líderes do setor já falaram sobre ransomware GenAI.

É realmente interessante de observar, já que basicamente a China tem jogado um sussurro de pânico chinês mais cego.

Definitivamente interessante, pois você tem organizações grandes e confiáveis publicando besteiras absolutas – e grandes figuras da indústria repetindo isso, e pesquisas com CISOs dizendo que estão vendo 70% dos ransOmware sendo IA (spoiler: não são, provavelmente não lidaram com um único incidente de ransomware).

Grande parte disso é sobre manter orçamentos CISO e fazer vendas.

Mas também há muita gente que não percebe o que está acontecendo, e não é baseado em evidências. Constrangedor para mim.

Se você está se perguntando o que tudo isso tem a ver com a China, aliás: a China sabe que o Ocidente é obcecado por ameaças de IA. É uma maneira muito fácil de distrair países inteiros.

Há um motivo pelo qual coisas do tipo ‘ah não, o ator ameaçador fez um malware GenAI completamente ruim usando ChatGPT’ continuam surgindo, em vez de usar ferramentas de IA hospedadas localmente.

Eles têm um ponteiro laser, e vocês são os gatos deles, enquanto eles levam a ração de vocês para gatos. Eles querem ser vistos.

Se você não acredita em mim, aliás, o material gerado naquele relatório “blockbuster” do WSJ tinha chinês. Arquivos WAV com músicas embutidas nele, e piadas. E nem rodou direito. E todo mundo saiu correndo de um penhasco com ele, em pânico, tomando medidas sem nenhuma informação.

Pessoalmente, acho que vale a pena porque eles estão dando voltas em torno de todo mundo. A melhor forma de garantir que as organizações não façam fundações reais de segurança é por meio dessa estratégia.”

Me siga no Twitter:@securityaffairseFacebookeMastodonte

(SecurityAffairs–hacking, Anthropic)