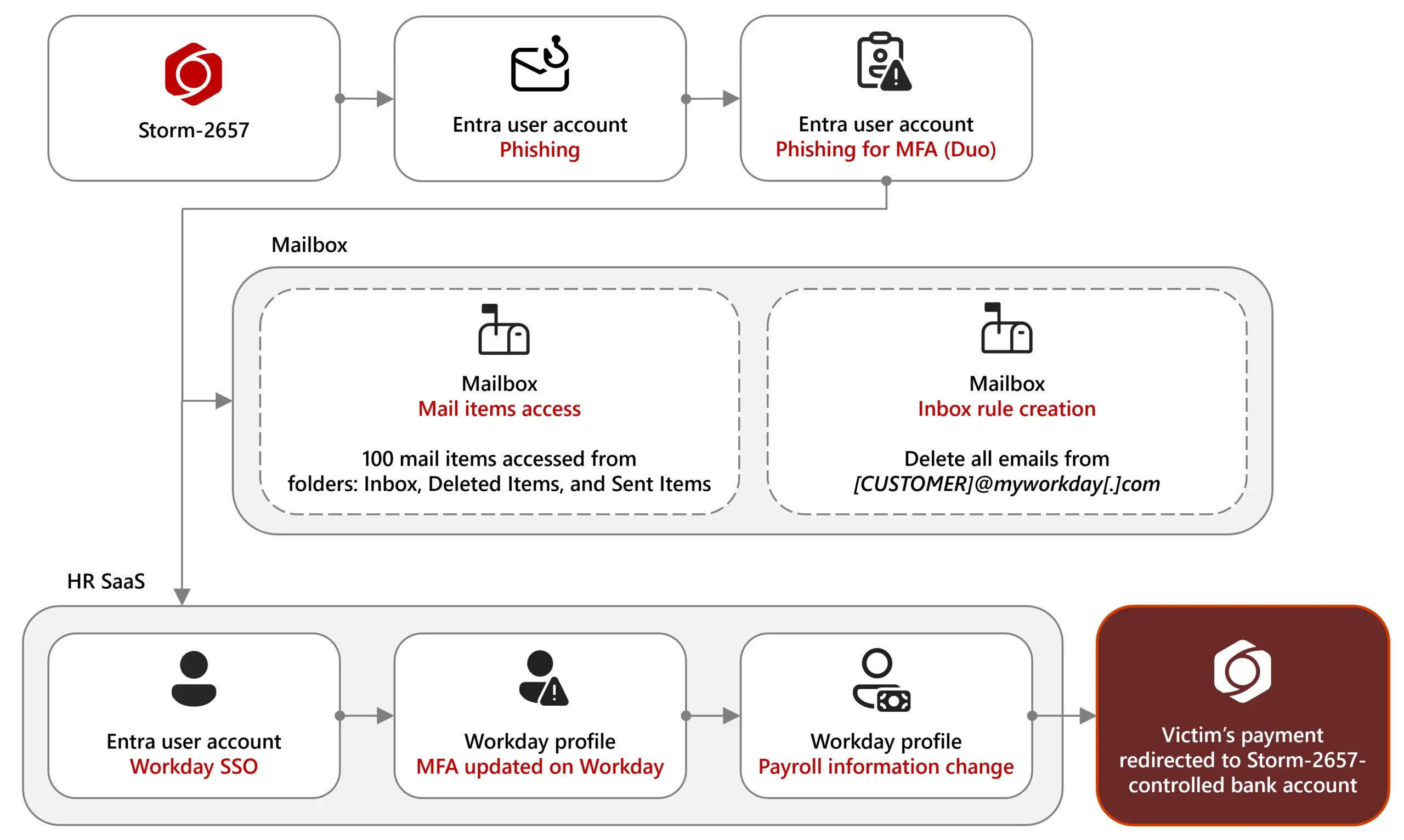

Uma gangue de crimes cibernéticos rastreada como Storm-2657 tem como alvo funcionários de universidades nos Estados Unidos para sequestrar pagamentos de salários em ataques de “folha de pagamento pirata” desde março de 2025.

Os analistas de inteligência de ameaças da Microsoft que detectaram essa campanha descobriram que os agentes de ameaças têm como alvo as contas do Workday; no entanto, outras plataformas de software como serviço (SaaS) de recursos humanos (RH) de terceiros também podem estar em risco.

“Observamos 11 contas comprometidas com sucesso em três universidades que foram usadas para enviar e-mails de phishing para quase 6.000 contas de e-mail em 25 universidades” Microsoft ele disse em um relatório de quinta-feira.

“Esses ataques não representam nenhuma vulnerabilidade na plataforma ou nos produtos Workday, mas sim agentes de ameaças motivados financeiramente usando táticas sofisticadas de engenharia social e aproveitando a completa falta de autenticação multifator (MFA) ou a falta de MFA resistente a phishing para comprometer contas.”

Os invasores estão usando vários temas em e-mails de phishing, personalizados para cada alvo, desde avisos de surtos de doenças no campus até relatórios de má conduta do corpo docente, para induzir os destinatários a clicar em links de phishing.

Outros exemplos incluem e-mails se passando pelo reitor da universidade, compartilhando informações sobre remuneração e benefícios ou documentos falsos compartilhados pelo RH.

Em alguns casos, os agentes de ameaças também registraram seus próprios números de telefone como dispositivos MFA para contas comprometidas, seja por meio de perfis do Workday ou configurações do Duo MFA, para estabelecer persistência. Isso permitiu que eles evitassem a detecção aprovando outras ações maliciosas em seus próprios dispositivos.

golpes de comprometimento de e-mail comercial (BEC) direcionados a empresas e indivíduos que fazem pagamentos por transferência eletrônica regularmente.

golpes de comprometimento de e-mail comercial (BEC) direcionados a empresas e indivíduos que fazem pagamentos por transferência eletrônica regularmente.

Em 2024, o Centro de Reclamações de Crimes na Internet (IC3) do FBI exarado mais de 21.000 reclamações de fraude BEC, resultando em perdas de mais de US$ 2,7 bilhões, o segundo tipo de crime mais lucrativo atrás dos golpes de investimento.

No entanto, esses números são baseados em casos conhecidos relatados pelas vítimas diretamente ou descobertos pela polícia e, portanto, provavelmente representam apenas uma fração das perdas reais.

O Evento de Validação de Segurança do Ano: O Picus BAS Summit

Junte-se ao Cúpula de Simulação de Violação e Ataque e experimente o Futuro da validação de segurança. Ouça os principais especialistas e veja como BAS alimentado por IA está transformando a simulação de violação e ataque.

Não perca o evento que moldará o futuro da sua estratégia de segurança

Sergiu Gatlan

Sergiu é um repórter que cobre os mais recentes desenvolvimentos tecnológicos e de segurança cibernética há mais de uma década. Envie um e-mail ou Twitter DMs para obter dicas.